C'est l’une des questions que vous me posez le plus souvent.

Pas "quel est le meilleur prompt ?"

Pas "comment utiliser l'IA pour gagner du temps ?"

Mais:

"Est-ce que je peux faire confiance aux IA avec mes données ?"

Et c'est toujours les mêmes profils qui posent la question. Les avocats. Les gens dans la finance. Les médecins. Les RH. Tous ceux qui manipulent des données sensibles au quotidien.

Et ils ont raison de se poser la question.

Parce que quand vous tapez un contrat client dans ChatGPT, quand vous collez un bilan financier dans Claude, quand vous faites résumer un dossier médical par Gemini… ces données partent quelque part.

Et ce "quelque part", personne ne vous l'explique vraiment.

Alors laissez-moi le faire.

Mais avant ça, si la protection de vos données est un sujet qui vous parle, ça tombe bien, c'est aussi la mission de notre sponsor Genevois:

Free email without sacrificing your privacy

Gmail tracks you. Proton doesn’t. Get private email that puts your data — and your privacy — first.

Bon, revenons à nos modèles. Laissez-moi vous expliquer comment tout ça marche.

Aujourd'hui dans le monde de l'IA, il y a deux grandes familles de modèles.

Les modèles propriétaires: ChatGPT, Claude, Gemini. Ce sont les plus puissants. Les plus intelligents. Des milliards de dollars de recherche derrière. Le problème ? Vos données transitent par leurs serveurs. Souvent aux États-Unis.

D'ailleurs, vous avez vu ce qui s'est passé il y a deux semaines ?

Anthropic (la boîte derrière Claude) a refusé que l'armée américaine utilise son IA pour la surveillance de masse des citoyens ou dans des systèmes d'armes autonomes. Quelques heures plus tard, OpenAI signait le contrat avec le Pentagone…

Résultat : les désinstallations de ChatGPT ont explosé de 295% en un jour. 2,5 millions de personnes ont quitté la plateforme.

Ça vous montre à quel point la question de la sécurité et de l'éthique est devenue centrale, même pour le grand public.

Les modèles open source: là, le code est ouvert. N'importe qui peut le télécharger et le faire tourner sur ses propres serveurs.

Le mot clé, c'est bien "ses propres serveurs." Parce que si le modèle tourne chez vous, vos données ne sortent jamais. Elles restent chez vous. Point final.

C'est ça, la vraie promesse de l'open source pour la sécurité.

Maintenant, dans le monde de l'open source, il y a un deuxième débat que personne ne vous explique.

Il y a les modèles européens (comme Mistral). Et les modèles asiatiques (comme Qwen, DeepSeek…).

La réalité, aussi frustrante soit-elle : les modèles asiatiques sont aujourd'hui significativement meilleurs que les européens. On parle pas d'un petit écart. Et surtout, les asiatiques rivalisent avec ChatGPT sur beaucoup de tâches. Les européens, pas encore.

Le hic, c'est que les modèles asiatiques peuvent porter certains biais liés à leurs données d'entraînement.

(Fun fact : ces biais ne sont pas forcément "asiatiques." L'anglais représente ~45% des données d'entraînement de la plupart des modèles. Résultat : même un modèle chinois porte un biais occidental.)

Donc le dilemme, c'est :

→ Un modèle européen "neutre" mais nettement moins performant ?

→ Ou un modèle asiatique puissant, avec des biais à corriger ?

Et c'est là que la question de la sécurité devient intéressante. Parce qu'en réalité, quand on parle de "sécurité de l'IA", on mélange deux choses : la confidentialité de vos données (où elles vont, qui les utilise) et la fiabilité du modèle (ses biais, ses erreurs, ses valeurs).

Les deux comptent. Surtout si vous êtes avocat ou dans la finance.

Alors, quelles options on a aujourd'hui ?

Option 1 : Utiliser les modèles propriétaires (ChatGPT, Claude…) et accepter que vos données transitent par des serveurs tiers. Pour beaucoup d'usages, c'est suffisant. Et la qualité est imbattable.

Option 2 : Héberger soi-même un modèle open source. Sécurité maximale, mais il faut l'infrastructure, les compétences techniques, et on se retrouve avec des modèles souvent inférieurs.

Option 3 : Passer par un tiers de confiance qui fait tourner les meilleurs modèles open source sur ses propres serveurs, sans stocker vos données.

C'est cette troisième voie que je trouve la plus intéressante pour la majorité des gens.

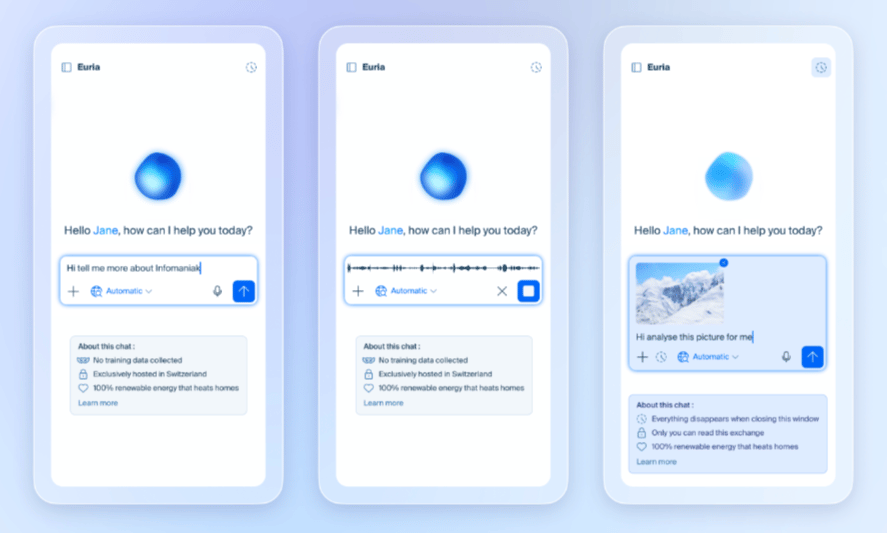

Et à Genève, on a la chance d'avoir l'une des plus grosses boîtes tech suisses qui fait exactement ça : Infomaniak. J'ai eu l'occasion d'échanger avec leur équipe récemment, et voilà ce que j'ai appris sur leur IA Euria.

Leur approche : ils utilisent les meilleurs modèles open source disponibles (y compris les asiatiques, comme Qwen), ils corrigent les biais par eux-mêmes, et surtout, vos données ne sont ni stockées, ni utilisées pour l'entraînement. Rien.

Tout tourne sur des serveurs en Suisse.

Ils espèrent qu'un jour les modèles européens comme Apertus (Suisse) ou Mistral seront au niveau. Mais en attendant, plutôt que de vous proposer un modèle médiocre au nom du "100% européen", ils ont fait le choix pragmatique :

le meilleur modèle possible, avec une sécurité maximale.

Et je respecte ça. Parce que soyons francs : une IA "sécurisée" que personne n'utilise parce qu'elle est dix fois moins bonne que ChatGPT… ça ne sécurise rien du tout.

Bon, maintenant je vais être honnête avec vous.

Si vos données ne sont pas confidentielles (si vous rédigez un post LinkedIn, si vous brainstormez des idées, si vous cherchez de l'inspiration, projet personnel…), entre nous, utilisez juste les meilleurs outils. Point. Ne vous compliquez pas la vie.

Par contre, si vous manipulez des données clients, des contrats, des bilans, des dossiers médicaux… là, c'est une autre histoire.

Ce que je recommande personnellement, c'est un mix :

→ Claude pour la puissance brute. Quand vous avez besoin du meilleur modèle, pour des tâches non sensibles, c'est ce que j'utilise au quotidien.

→ Euria (par Infomaniak) pour tout ce qui touche à des données sensibles: transcription, PV, mails confidentiels, recherche contextualisée. Vos données restent en Suisse, ne sont jamais stockées ni utilisées. Point final.

La sécurité, c'est pas un choix binaire. C'est pas "tout sécurisé" ou "rien du tout." C'est savoir quand protéger ses données et quand utiliser la puissance maximale sans se prendre la tête.

Et ça, maintenant, vous savez le faire.

À très vite,

Salim de GenevIA

P.S. à quel point vous sentez vous concerner par la sécurité et l’IA ?